Samsung Electronics đã chính thức quyết định rút ngắn đáng kể chu kỳ phát triển của bộ nhớ băng thông cao (HBM) từ khoảng hai năm xuống dưới một năm. Có thông tin cho rằng Samsung đã xây dựng và thực hiện kế hoạch ra mắt thế hệ HBM mới hàng năm để phù hợp với tốc độ phát hành các máy tăng tốc AI mới từ các khách hàng lớn như NVIDIA.

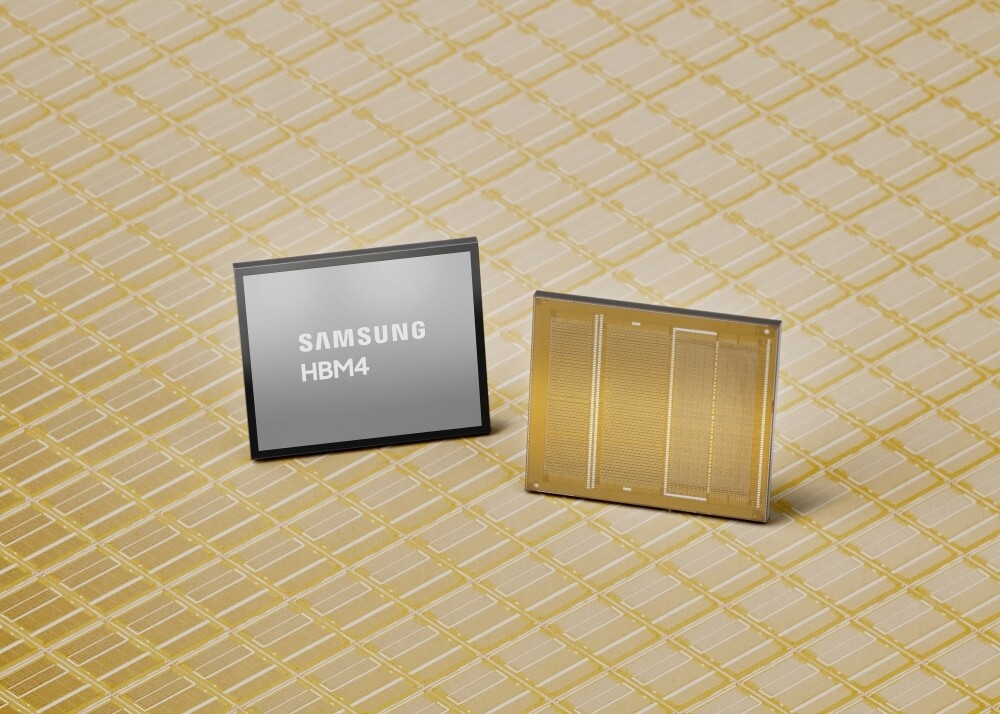

HBM là thành phần cốt lõi của máy gia tốc AI. Sản phẩm sản xuất hàng loạt mới nhất của Samsung là HBM3E, và HBM4 thế hệ tiếp theo dự kiến sẽ ra mắt trong năm nay với nền tảng NVIDIA Vera Rubin và AMD Instinct MI400.

Vào tháng 3 năm nay, Samsung đã công khai trình diễn các mẫu vật lý HBM4E tại NVIDIA GTC 2026, mẫu này có thể đạt tốc độ truyền 16Gbps và băng thông 4,0TB/s. Lô mẫu HBM4E đầu tiên đã được khóa sản xuất vào tháng 5 năm 2026 và sẽ được NVIDIA ưu tiên đánh giá.

Tuy nhiên, các nhà sản xuất máy gia tốc AI nhìn chung đã chuyển sang chu kỳ phát hành các sản phẩm thế hệ mới hàng năm. Nếu các nhà cung cấp HBM không theo kịp, họ sẽ phải đối mặt với nguy cơ tụt hậu về công nghệ, thậm chí mất khách hàng.

Khẩn cấp hơn, dữ liệu từ công ty nghiên cứu thị trường Counterpoint cho thấy SK Hynix dự kiến sẽ chiếm khoảng 54% thị trường HBM toàn cầu vào năm 2026, trong khi Samsung chỉ có khoảng 28%.

Sáng kiến thu gọn chu trình nghiên cứu và phát triển lần này của Samsung về cơ bản là để điều chỉnh lộ trình của khách hàng với nhịp điệu của chuỗi cung ứng và đưa chính nó vào chuỗi cốt lõi của hệ sinh thái phần cứng AI.

Phó chủ tịch điều hành sản phẩm bộ nhớ và công nghệ Samsung SangJoon Hwang đã tiết lộ tại GTC 2026 rằng khuôn cơ bản của HBM5 sẽ được nâng cấp từ quy trình 4nm lên quy trình 2nm qua nhiều thế hệ.