Ngày 15 tháng 4, Bloomberg đưa tin rằng một nghiên cứu mới cho thấy các chatbot do AI điều khiển cung cấp câu trả lời cho các câu hỏi nghi vấn trong khoảng một nửa thời gian khi cung cấp lời khuyên y tế. Phát hiện này nêu bật những rủi ro về sức khỏe của AI, một công nghệ mới ngày càng được tích hợp vào cuộc sống hàng ngày.

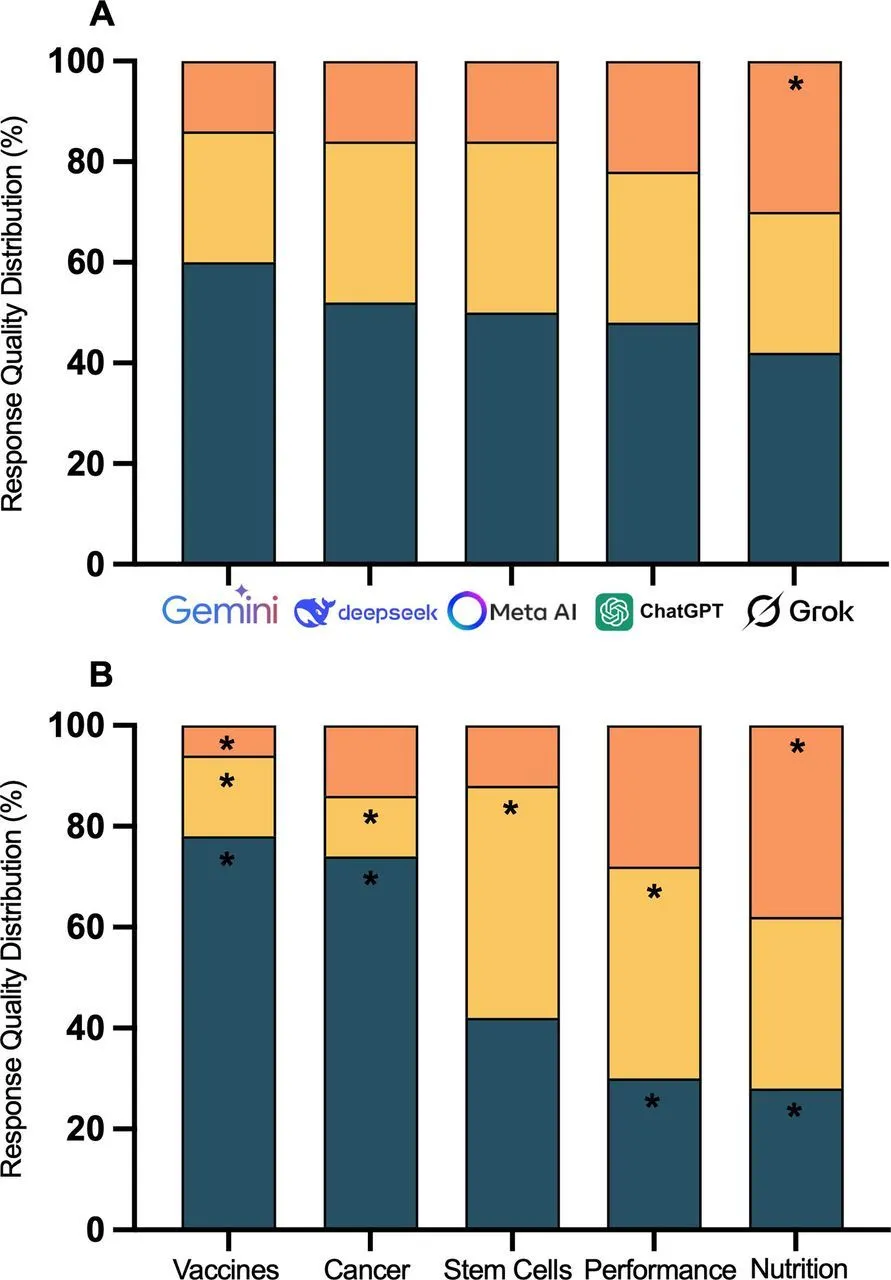

Các nhà nghiên cứu từ Hoa Kỳ, Canada và Vương quốc Anh đã đánh giá 5 nền tảng AI hàng đầu: ChatGPT, Gemini, Meta AI, Grok và DeepSeek, bằng cách hỏi mỗi nền tảng 10 câu hỏi thuộc 5 danh mục sức khỏe. Theo nghiên cứu được công bố trong tuần này trên tạp chí y khoa BMJ Open, khoảng 50% tổng số phản hồi từ các chatbot AI này được coi là “có vấn đề”, với gần 20% được phân loại là “rất đáng nghi vấn”.

Nghiên cứu cho thấy hiệu suất của các chatbot này đối với các loại câu hỏi khác nhau khác nhau đáng kể: chúng hoạt động tương đối tốt hơn đối với các câu hỏi đóng (câu trả lời là chắc chắn) và các câu hỏi liên quan đến vắc xin và ung thư, nhưng hoạt động kém hơn đối với các câu hỏi mở và các lĩnh vực như nghiên cứu tế bào gốc và dinh dưỡng.

Màu vàng nghĩa là có vấn đề, màu cam nghĩa là có vấn đề về chiều cao Câu hỏi

Các câu trả lời thường được đưa ra một cách tự tin Các nhà nghiên cứu cho biết, không có chatbot nào cung cấp danh sách tham chiếu đầy đủ và chính xác để đáp lại bất kỳ lời nhắc nào. Trong suốt quá trình nghiên cứu, chatbot chỉ từ chối trả lời các câu hỏi hai lần, cả hai đều từ Meta AI.

Các phát hiện nêu bật mối lo ngại ngày càng tăng rằng mọi người đang ngày càng sử dụng các nền tảng AI tổng hợp để nhận lời khuyên y tế, nhưng những nền tảng này không được cấp phép để cung cấp lời khuyên y tế và thiếu phán đoán lâm sàng cần thiết để đưa ra chẩn đoán.

Sự bùng nổ của chatbot AI đã khiến nó trở thành công cụ phổ biến cho những người đang tìm kiếm hướng dẫn về căn bệnh của họ. OpenAI cho biết hơn 200 triệu người truy cập ChatGPT mỗi tuần để hỏi các câu hỏi về sức khỏe và thể chất. Nền tảng này đã công bố vào tháng 1 năm nay rằng họ sẽ tung ra các công cụ y tế riêng biệt cho người dùng phổ thông và bác sĩ lâm sàng. Trong cùng tháng, Anthropic cũng thông báo rằng sản phẩm Claude của họ sẽ ra mắt dịch vụ chăm sóc sức khỏe mới.

Rủi ro đáng kể nếu chatbot được triển khai mà không có giáo dục và quy định công cộng là chúng có thể khuếch đại sự lan truyền thông tin sai lệch, các tác giả của nghiên cứu được công bố trên BMJ Open cho biết.

Họ cho biết những phát hiện này "nêu bật những hạn chế quan trọng về hành vi của AI và chứng minh sự cần thiết phải đánh giá lại cách triển khai chatbot AI trong truyền thông y tế và sức khỏe cộng đồng." Họ cũng lưu ý rằng những hệ thống này thường có thể tạo ra "những phản hồi nghe có vẻ có thẩm quyền nhưng có thể có sai sót".