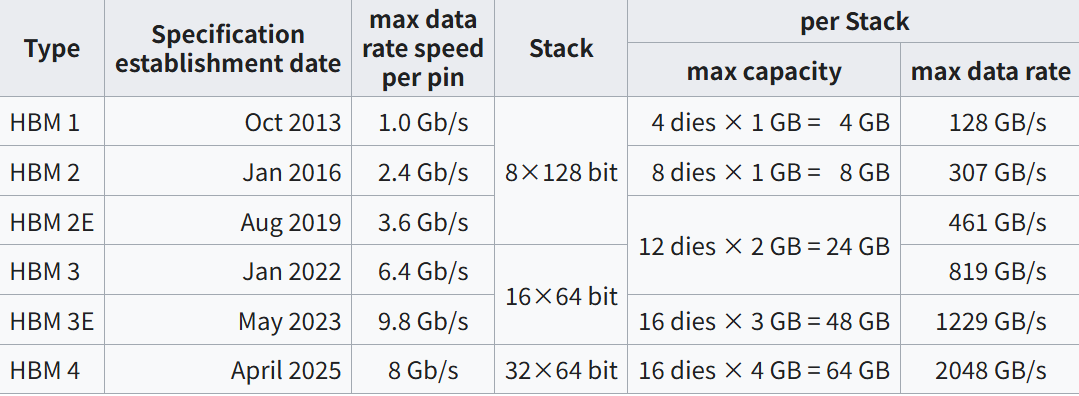

HBM đã trở thành một trong những chip chủ chốt trong lĩnh vực AI, thậm chí còn quan trọng như chip điện toán như GPU. Sự bùng nổ nhu cầu về HBM cũng là động lực chính khiến đợt tăng giá bộ nhớ này. Hiện nay, thế hệ HBM mới nhất trên thế giới đã đạt tới HBM4. Dòng MI450 và Vera Rubin được AMD và NVIDIA ra mắt trong năm nay sẽ là dòng đầu tiên sử dụng bộ nhớ HBM4, nhưng HBM3e vẫn sẽ là lựa chọn chủ đạo.

Tại triển lãm SEMICON Trung Quốc 2026 gần đây, các nhà sản xuất trong nước cũng trưng bày các sản phẩm liên quan đến HBM. Trong số đó, Changdian Technology đã đưa ra giải pháp đóng gói HBM3e, sử dụng công nghệ xếp chồng 2.5D tiên tiến để tăng mật độ kết nối lên 20% và băng thông lên 960GB/s.

HBM3e có thể thích ứng hoàn hảo với chip AI cao cấp có quy trình 3nm trở xuống và đã nhận được đơn đặt hàng từ những gã khổng lồ như AMD và NVIDIA.

Tuy nhiên, cần lưu ý rằng Changdian Technology là một công ty đóng gói chip nổi tiếng ở Trung Quốc và không tự sản xuất chip HBM3e. Dù là chip cơ sở Base Die hay chip nhớ DRAM, họ đều cung cấp giải pháp đóng gói, đóng gói các chip này thành thành phẩm HBM3e.

Hiện tại không chắc chip HBM3e của họ đến từ hãng nào. Tất nhiên, sẽ tốt hơn nếu là con chip nội địa giải quyết được vấn đề kẹt cổ.

Cũng tại triển lãm SEMICON Trung Quốc 2026, Giám đốc điều hành Changdian Technology Zheng Li đã đề cập trong bài phát biểu quan trọng của mình rằng việc sản xuất tấm bán dẫn truyền thống đã đạt đến giới hạn vật lý 1nm, chi phí và hiệu ứng đường hầm lượng tử tạo thành những nút thắt đáng kể và việc đóng gói ở cấp độ nguyên tử đang trở thành con đường đột phá cốt lõi trong thời kỳ hậu Moore.

Dựa vào bốn công nghệ cốt lõi như lắng đọng lớp nguyên tử ALD và liên kết lai, Công nghệ Changdian đã đạt được sự cải thiện ở mức độ lớn về độ chính xác của việc đóng gói: độ chính xác căn chỉnh đã được nâng cao từ ±5μm lên <10nm, mật độ kết nối đã vượt quá 60.000 điểm tiếp xúc/mm2 và khoảng cách giao diện đã đạt đến cấp độ nguyên tử không có khoảng trống, hoàn thành bước nhảy vọt về công nghệ gấp ba bậc độ lớn.