Tin tức ngày 23 tháng 4, vào thứ Tư, giờ Mỹ, Google đã chính thức thông báo rằng bộ xử lý tensor (TPU) thế hệ thứ tám của họ đã mở ra một sự điều chỉnh chiến lược lớn: lần đầu tiên, nhiệm vụ "huấn luyện" và "suy luận" của mô hình AI sẽ được tách riêng và giao cho hai chip độc quyền độc lập để xử lý. Hai bộ xử lý thế hệ tiếp theo này dự kiến sẽ được tung ra thị trường vào cuối năm nay.

Động thái này đánh dấu một vòng cạnh tranh mới giữa Google và Nvidia trong lĩnh vực phần cứng AI.

“Tại sao lại chuyển sang chuyên môn hóa sức mạnh tính toán?” Amin Vahdat, phó chủ tịch cấp cao kiêm giám đốc công nghệ AI và cơ sở hạ tầng của Google, cho biết trong một bài đăng trên blog chính thức.

Hiện tại, tốc độ suy luận AI đang trở thành chiến trường cốt lõi của cuộc chơi giữa các nhà sản xuất lớn. Vào tháng 3, Nvidia đã giới thiệu một loại chip mới sắp ra mắt cho phép các mô hình phản hồi nhanh chóng các câu hỏi của người dùng, phần lớn nhờ vào công nghệ có được trong thương vụ mua lại công ty khởi nghiệp chip Groq trị giá 20 tỷ USD. Trong bối cảnh này, mặc dù Google vẫn là đối thủ chính của NVIDIA khách hàng, họ đang xây dựng các giải pháp sức mạnh điện toán thay thế bằng cách cung cấp TPU cho các công ty dịch vụ đám mây.

Trên thực tế, cả ngành đã đồng thuận rằng các gã khổng lồ công nghệ đã tự mình xây dựng lõi và tìm kiếm sức mạnh tính toán độc lập thông qua việc tùy chỉnh chuyên sâu kiến trúc cơ bản, các doanh nghiệp có thể tối đa hóa hiệu quả hoạt động của các kịch bản ứng dụng cụ thể, từ Neural Engine mà Apple đã tích hợp vào iPhone trong nhiều năm qua, cho đến chip AI thế hệ thứ hai của Microsoft được lặp lại vào tháng 1 năm nay. Năm sau, theo tiết lộ gần đây của Meta rằng họ đang hợp tác với Broadcom để phát triển nhiều bộ xử lý AI, tất cả đều xác nhận xu hướng này.

Trong “phong trào tạo lõi” này, Google là công ty tiên phong bắt đầu triển khai bộ xử lý AI tự phát triển vào năm 2015 và đã cung cấp dịch vụ sức mạnh điện toán cho khách hàng bên ngoài thông qua nền tảng đám mây kể từ năm 2018. Để so sánh, Amazon AWS đã ra mắt chip Inferentia dành riêng cho bộ xử lý suy luận và Trainium dành riêng cho mình. đến đào tạo vào năm 2018 và 2020.

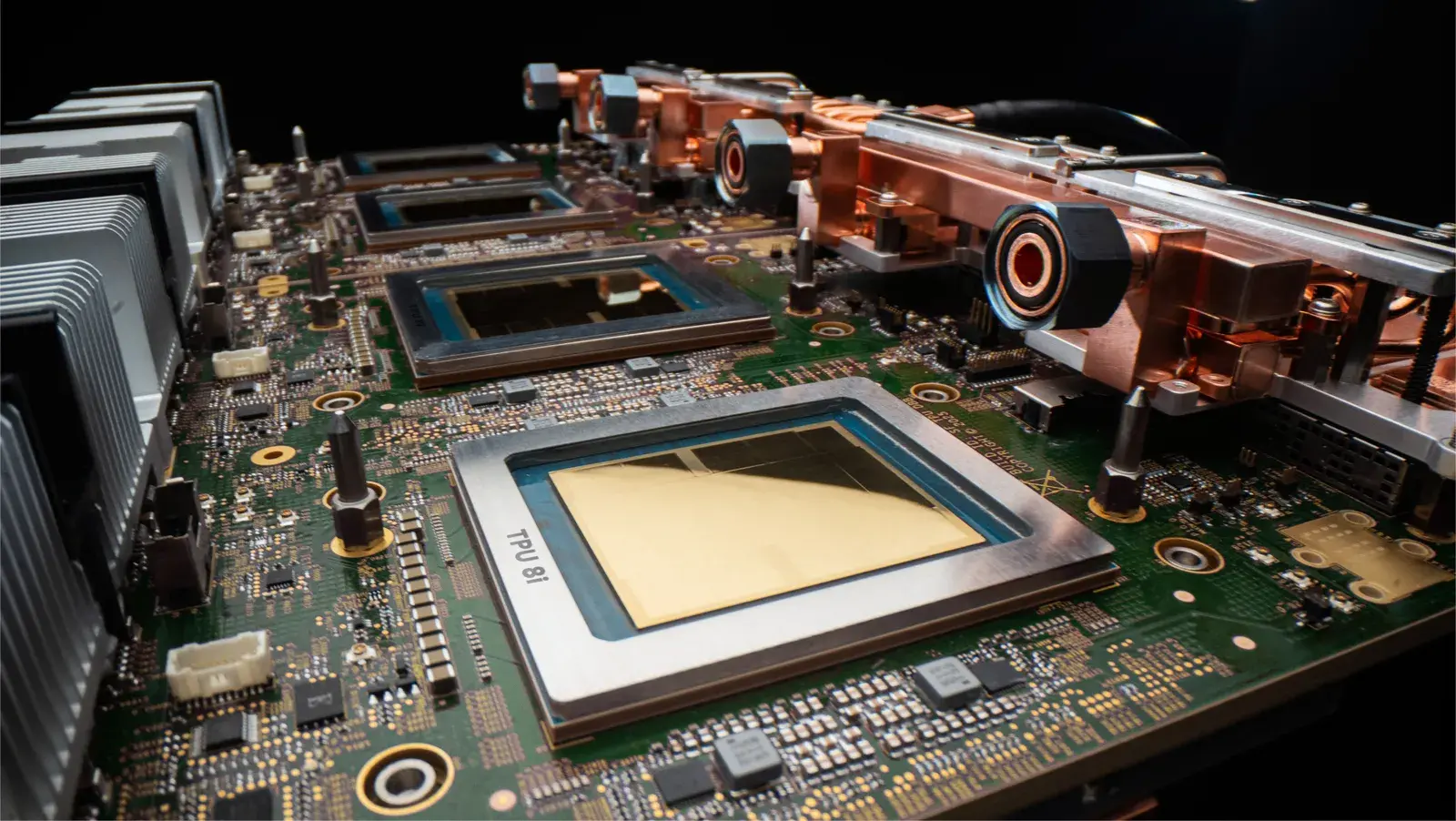

Trong một báo cáo vào tháng 9 năm ngoái, các nhà phân tích từ ngân hàng đầu tư D.A. Davidson ước tính rằng tổng giá trị của mảng kinh doanh TPU của Google và bộ phận AI của DeepMind sẽ vào khoảng 900 tỷ USD. thị trường. Google không trực tiếp đánh giá các sản phẩm tương tự của Nvidia trong bản phát hành này nhưng tiết lộ dữ liệu lặp lại hiệu suất của riêng mình: với cùng mức giá, hiệu suất của chip đào tạo mới gấp 2,8 lần so với TPU thế hệ thứ bảy (tên mã là Ironwood) được phát hành vào tháng 11 năm ngoái và hiệu suất của chip suy luận mới đã tăng 80%. Bộ nhớ truy cập ngẫu nhiên (SRAM) Cho dù đó là Groq 3 LPU sắp ra mắt của Nvidia hay kỳ lân chip AI Cerebras vừa nộp đơn đăng ký IPO trong tháng này, tất cả đều phụ thuộc rất nhiều vào công nghệ này. Chip suy luận mới TPU 8i được Google ra mắt lần này cũng đi theo xu hướng này.

Giám đốc điều hành Alphabet Sundar Pichai đã chỉ ra trong một bài đăng trên blog rằng mục tiêu thiết kế của kiến trúc mới là "cung cấp thông lượng lớn (Thông lượng) và độ trễ thấp (Độ trễ), từ đó hỗ trợ hoạt động đồng thời của hàng triệu tác nhân AI với hiệu quả chi phí cực cao."Về các ứng dụng đầu cuối, Google tiết lộ rằng việc thương mại hóa chip AI của họ đang mở rộng. Trong số đó, nhà tạo lập thị trường Citadel Securities đã phát triển phần mềm nghiên cứu định lượng dựa trên TPU; 17 phòng thí nghiệm quốc gia thuộc Bộ Năng lượng Hoa Kỳ đang triển khai đầy đủ hệ thống “Nhà đồng khoa học AI” dựa trên con chip này. Ngoài ra, công ty khởi nghiệp AI Anthropic đã cam kết sử dụng nguồn năng lượng tính toán TPU của Google với công suất vài gigawatt.