Giá bộ nhớ đã tăng 3-5 lần trong năm nay, điều này ảnh hưởng nghiêm trọng đến ý định sử dụng PC và điện thoại di động của mọi người. Thủ phạm của sự tăng giá bộ nhớ lớn này là nhu cầu mạnh mẽ về AI. Ai cũng biết AI có yêu cầu rất cao về dung lượng và băng thông của bộ nhớ (bao gồm cả bộ nhớ video trên GPU), nhưng liệu nó có thể cao đến mức nào? TPU thế hệ thứ tám được Google phát hành vài ngày trước là ví dụ điển hình nhất.

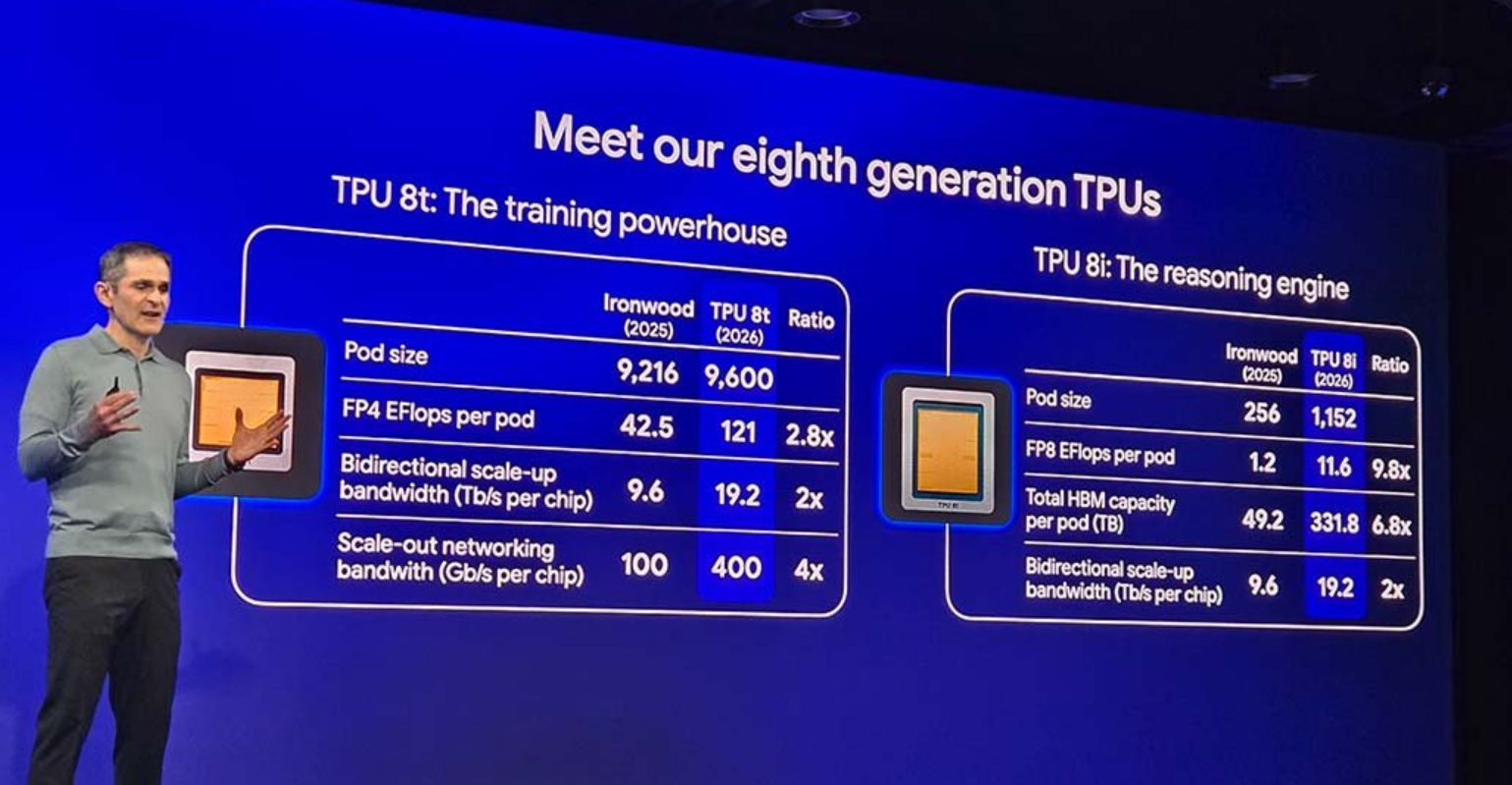

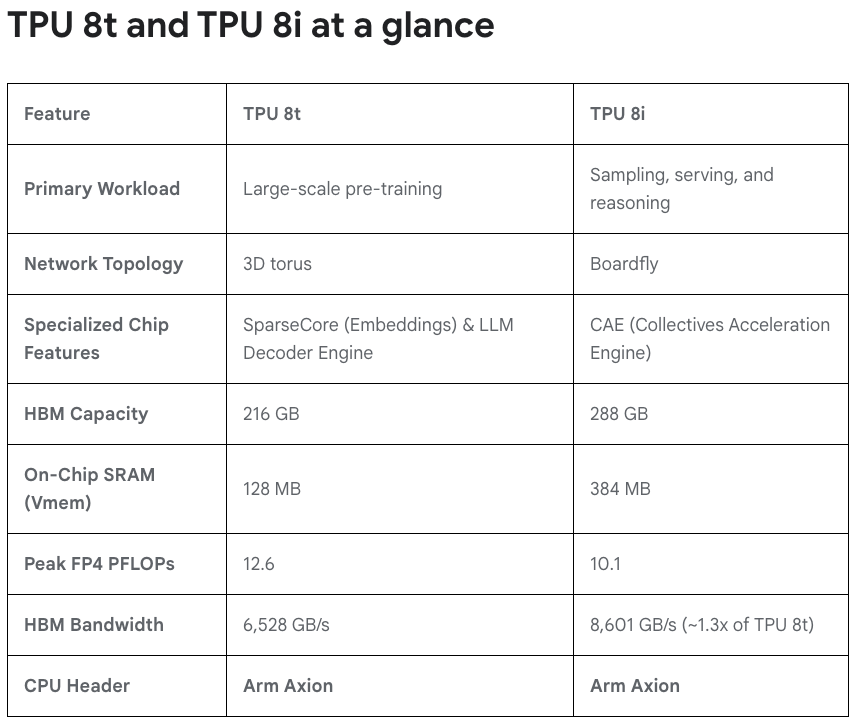

TPU năm nay Lần đầu tiên, v8 phân biệt giữa đào tạo và suy luận. V8T tập trung vào đào tạo AI. Mặc dù Google cho biết nó cũng có thể suy luận nhưng nó chủ yếu được sử dụng cho mục đích đào tạo. Mỗi nút Pod có 9.600 chip V8T được xếp chồng lên nhau. Hiệu suất FP4 đạt 121EFlops, băng thông bộ nhớ là 19,2TB/s và băng thông chip bên trong là 400GB/s, thay đổi gần như gấp 2-4 lần.

V8i chủ yếu nhắm đến khối lượng công việc suy luận AI và thông số kỹ thuật thấp hơn nhiều. Mỗi nút chỉ có 1152 chip V8i, sức mạnh tính toán giảm xuống còn 11,6EFlops và băng thông bộ nhớ không đổi ở mức 19,2TB/s.

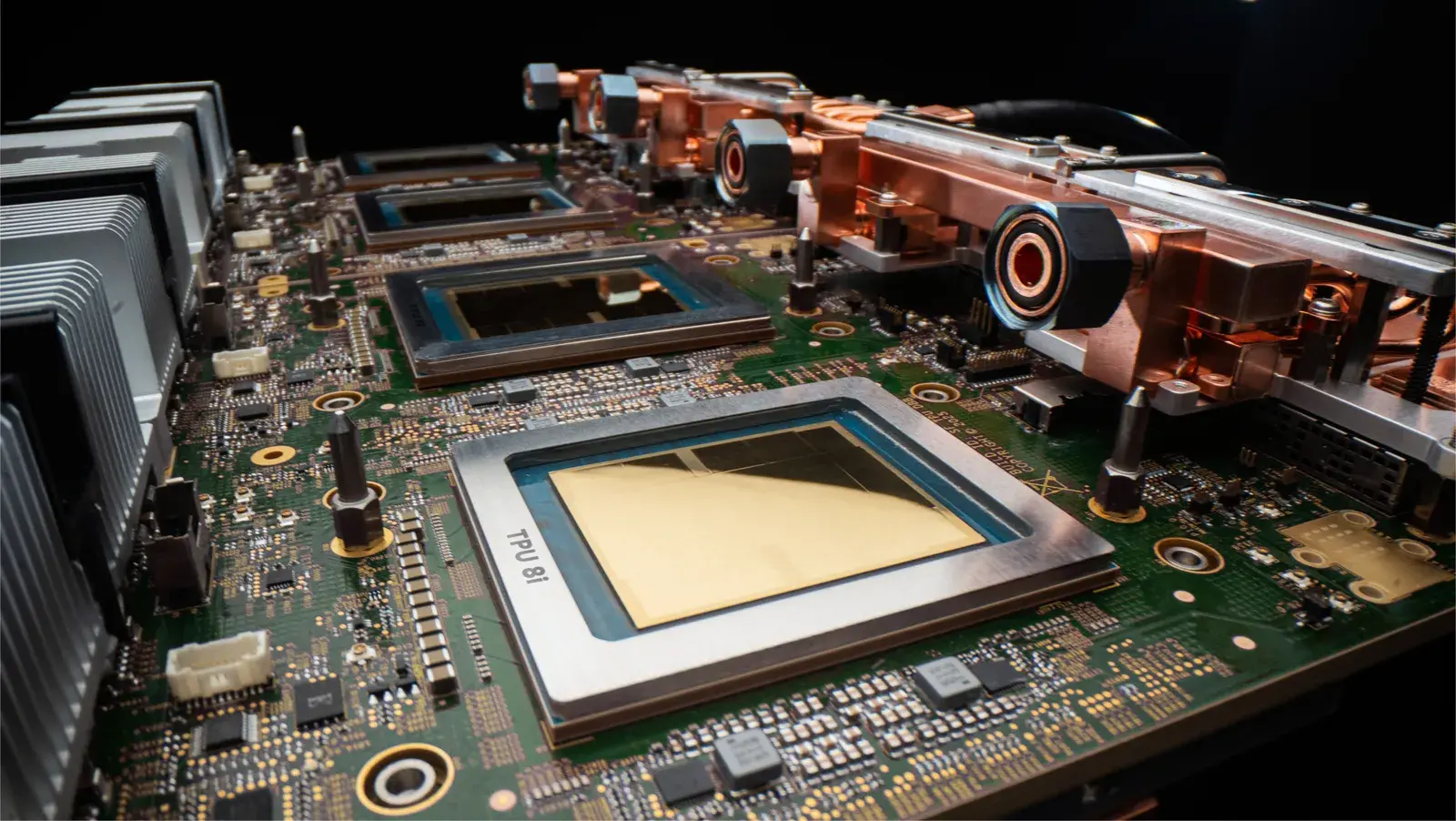

Điều đáng chú ý là lần này dung lượng bộ nhớ đã tăng lên đáng kể, V8i cũng đã đạt tới bộ nhớ HBM 331,8TB và V8T đã được phóng đại lên thành 2PB. Bộ nhớ HBM, mỗi chip V8T được trang bị bộ nhớ HBM 216GB.

Ý tưởng thiết kế của Google lần này là phá vỡ bức tường bộ nhớ của nút thắt cổ chai AI, 2PB HBM không chỉ có tổng dung lượng siêu lớn mà còn được sử dụng như một địa chỉ toàn cầu duy nhất trong một nút. Mặc dù GPU của NVIDIA trước đây có thể xếp chồng bộ nhớ HBM cấp PB thông qua các công nghệ như NVLink, nhưng kết nối không thể vượt qua mạng trung tâm dữ liệu truyền thống, điều này sẽ gây ra tắc nghẽn về hiệu suất và độ trễ.

Cố vấn trưởng của RobustCloud, Larry Carvalho, cho biết việc phá vỡ "bức tường bộ nhớ" đánh dấu một sự thay đổi cạnh tranh lớn tiềm tàng của Google trong lĩnh vực chip AI.

Nhưng đối với người dân bình thường, việc Google tung ra 2PB lần này bộ nhớ HBM không phải là một dấu hiệu tốt, vì điều đó có nghĩa là nhu cầu về bộ nhớ của AI vẫn đang tăng cao. Bạn phải biết rằng bộ nhớ HBM thường tiêu thụ công suất sản xuất chip DRAM gấp 2-4 lần so với bộ nhớ DDR thông thường. Càng sử dụng nhiều HBM thì dung lượng sản xuất bộ nhớ DDR càng chiếm nhiều.

Ngay cả khi nhu cầu tăng lên, các công ty như Samsung, SK Hynix và Micron sẽ ưu tiên đảm bảo nhu cầu HBM. Tuy nhiên, trước đó họ đã nói rõ rằng họ sẽ không tăng đáng kể năng lực sản xuất chip. Rõ ràng, tình trạng thiếu chip nhớ sẽ trở nên nghiêm trọng hơn nên đừng mong giá sẽ giảm trở lại nhanh chóng.